2025最新开源LLM完整指南:性能、许可和实用性的彻底比较

在本文中,2025年出现的代表性开源LLM的彻底比较我会。它全面地解释了决策所需的信息,不仅包括每个型号的技术特征和性能指标,还包括许可条件和商业使用可用性,这些在实际开发站点中非常重要,因此请将此作为选择最佳型号的实用指南。

①Meta Llama 4:实现大规模上下文处理和图像识别

Meta 的 Llama 4 系列采用混合专家 (MoE) 架构,具有多模式功能,不仅支持文本输入,还支持图像输入。

骆驼4的主要特点

Llama 4是Meta发布的最新一代LLM。采用专家混合 (MoE) 架构它具有支持文本和图像输入的多模式功能。

模型有两种类型:“Scout”,总共 1090 亿个参数(约 170 亿个活跃参数)和“Maverick”,总共 4000 亿个参数(约 170 亿个活跃参数)。 Maverick 能够处理多达约 100 万个令牌的上下文,而 Scout 能够处理 1000 万个令牌的更长上下文,使其能够同时处理大型文档和复杂的交互历史记录。

骆驼4的表演

Meta 宣布 Llama 4 在某些基准测试中优于 OpenAI 的 GPT-4o。特别是,据说在“LMArena”评估中优于GPT-4o,但这是经过对话优化的私有版本的结果,并且已经指出了与公共模型的差异。

然而,4000亿参数类模型的开放提供是革命性的,它在代码生成和数学问题等广泛领域展示了接近GPT-4的高性能。

Llama 4 许可和商业用途

Llama 4 是根据 Meta 独特的“社区许可证”提供的。月活跃用户超过7亿的服务的商业使用受到限制。因此,需要单独的许可。

此外,禁止使用输出来训练其他模型,方便中小型开发者使用,但对大型平台公司施加限制。

②Mistral AI Mistral Small 3.2:体积虽小,效率与精度却惊人

Mistral Small 3.2 于 2025 年 6 月发布240 亿个参数虽然是比较小的模型,但由于独特的优化极其高效和高性能我们正在意识到这一点。

Mistral Small 3.2的主要特点

Mistral Small 3.2是法国Mistral AI公司发布的具有240亿个参数的中型模型。其前身 Mistral 3.1 与 Llama 3.3 具有相同的质量(700 亿个参数),但在响应速度上优于 Llama 3.3。

3.2中,跟随指令的能力和稳定性得到了提高,函数调用的可靠性也得到了提高。在HumanEval基准测试中达到了92.90%的准确率,编程性能也得到了增强。它还支持高达 128k 令牌和图像输入的长上下文处理,使其适合 RAG 和多模式代理应用程序。

Mistral Small 3.2的性能

3.1 的改进已被证实可以减少无限循环响应并提高对指令的遵从性。此外,虽然重量轻,但与 OpenAI GPT-4o mini 相比,其品质和响应速度更出色,具有效率和性能兼具的特点。

Mistral Small 3 系列许可和商业用途

它是在 Apache 2.0 许可下发布的,可以免费用于商业和非商业目的。修改或重新分发没有限制,这使其成为小型企业和初创公司的经济高效的选择。

③Google DeepMind Gemma 3:轻量级多语言通用移动法学硕士

Google DeepMind 的 Gemma 3 系列采用了 Google 内部尖端模型“Gemini”的技术,轻便高效机型它被设计为。

Gemma 3的主要特点

Gemma 3 是 Google DeepMind 发布的一组开放模型,设计时强调轻量级和高效性。它是一个多模态模型,除了文本之外还支持图像输入,并且有多个阵容,参数大小从2.7亿到270亿不等。即使是最大的模型,也能通过单个 GPU/TPU 实现实时运算的效率。

上下文长度高达 128k token,多语言支持约 140 种语言,适用于翻译和国际 QA 系统。移动版 Gemma 3n 也已推出,可在边缘设备上使用。

杰玛3的表现

这个 270 亿个模型使用 14 万亿个代币进行训练,比其他同等规模的模型效率更高。除了文本生成、摘要和推理之外,还可以进行图像分析和解释。谷歌强调效率与准确性的结合,得到了开发者社区的高度评价。

Gemma 3 许可和商业用途

它是根据 Google 自己的许可证(称为“Gemma 许可证”)提供的,可以进行商业用途,但 Google 保留在检测到未经授权的使用时暂停使用的权利。对于中小型使用没有大问题,但对于关键任务应用程序需要风险管理。

④阿里巴巴Qwen 3:切换思维模式的“混合推理”AI

Qwen 3系列是中国阿里云于2025年4月发布的最新一代开源LLM,具有“混合推理”能力。

Qwen 3主要特点

阿里云发布的Qwen 3系列是一个大家族,一次性发布了8类模型,参数数量从6000万到2350亿不等。旗舰产品 Qwen3-235B-A22B 包括 MoE 和紧密耦合模型,在代码生成和数学任务方面可与最先进的模型相媲美。它的特点是“混合推理”,可以让你在思维模式之间切换,让你使用快速反应和逐步反思推理。

Qwen 3的性能

它使用思维模式来提高复杂任务的准确性,并具有快速响应简单问题的灵活性。学习 119 种语言,在翻译和多语言 QA 方面具有优势。背后有36万亿代币的学习数据,被评为中国最强的开放模型之一。

Qwen 3 许可和商业用途

它根据 Apache 2.0 许可证提供,可免费用于商业用途、修改和重新分发。阿里巴巴官方允许抱脸等网站商业使用并分配权重。此外由于法规的原因,一些高级型号仅限于 API。整体而言,作为一个纯粹的开源正在引起全世界的关注。

⑤DeepSeek团队DeepSeek-R1:开放LLM中首个GPT-4级别推理能力

DeepSeek-R1DeepSeek-R1将于2025年初推出。深度搜索它是一个开源的LLM,由一个名为(可能是来自中国的初创公司)的研究团队发布。

DeepSeek-R1的主要特点

DeepSeek 团队发布的开源法学硕士,利用独特的强化学习来增强逻辑推理能力。「GRPO」介绍了。基础模型为MoE结构的DeepSeek-V3,通过自我验证学习获得高级思维能力。

DeepSeek-R1 性能

它在 AIME 2024 中取得了 79.8% 的高分,表现优于 GPT-4 和 Claude。它可与 OpenAI 在 MATH-500 和 SWE-bench 中的推理专业模型“o1”相媲美,并作为“第一个推理能力可与 GPT-4 相媲美的开放式 LLM”而受到关注。它还用于将知识提炼成小模型,有助于提高整个开放社区的性能。

DeepSeek-R1 许可和商业用途

最初是在 MIT 许可证下发布的,现在已转移到 Apache 2.0。它完全免费用于商业用途、修改和重新分发,并且公司也可以将其合并到他们的服务中。事实上,广泛的应用正在取得进展,基于 R1 的小型模型出现在竞赛中。

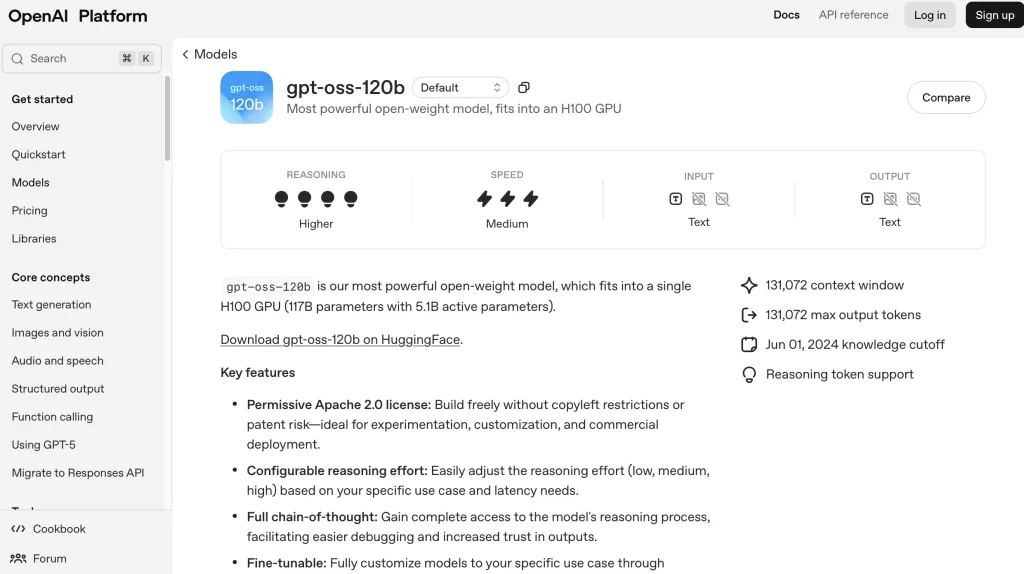

⑥OpenAI gpt-oss-120b/gpt-oss-20b:完全开放Apache授权版本的GPT

gpt-oss系列阵容包括大型“gpt-oss-120b”和轻量级“gpt-oss-20b”。

gpt-oss的主要特点

gpt-oss-120b是一个专家混合 (MoE) 结构化模型,具有约 1170 亿个参数,能够对多达 128K 个令牌进行长上下文处理。经过优化,可在单个 80 GB GPU 上运行,以提高计算效率。

另一方面,gpt-oss-20b是一个轻量级模型,拥有约 210 亿个参数,并具有资源节约型设计,使其可以在配备 16 GB 内存的笔记本电脑和智能手机上运行。

gpt-oss性能

在性能方面,gpt-oss-120b表现出了与OpenAI内部模型“o4-mini”相当的性能,并在数学(AIME 2024/25)、一般问题(MMLU、HLE)、代码生成(Codeforces)和医疗信息(HealthBench)等各种基准测试中获得了很高的评价。

此外,gpt-oss-20b还表现出与o3-mini相同或更好的性能,即使在小规模环境下也能实现尖端的AI处理。

gpt-oss系列许可及商业使用

一个主要特点是它是在完全开放的Apache 2.0许可证下提供的,可以免费用于商业和非商业目的。

⑦微软Phi-4家族:轻量级、高推理、MIT许可的通用模型

Phi-4系列由微软研究院开发,是一个开源的LLM家族,轻量级、高效、具有先进的推理性能。

Phi-4(基本型)

Phi-4是一个14B参数规模的基础模型,支持16k token的上下文长度。它在结合了合成数据、高质量公共领域数据、学术书籍和问答的数据集上进行训练,使用 SFT(监督微调)和 DPO(直接选择优化)来增强安全性并遵循指令。它在 MMLU (84.8)、MATH (80.4) 和 HumanEval (82.6) 等基准测试中表现出色,为通用模型奠定了良好的基础。

Phi-4-推理 / Phi-4-推理-Plus

推理专用型模型组,前者基于Phi-4并通过SFT进行调整,后者通过引入RL进一步增强。在 AIME 和科学领域的困难基准测试中表现出超越 DeepSeek-R1 系列大型模型的性能。它的优势在于即使在计算资源有限的环境中也能实现高推理能力和效率。

Phi-4-迷你推理

虽然是3.8B参数的轻量级模型,但是号称128k token。支持超长上下文处理。通过利用来自 DeepSeek-R1 等高性能模型的提取和合成数据,我们以紧凑的尺寸实现了高级数学推理功能。它适用于教育用途、移动边缘推理应用,并且在资源减少的环境中运行良好。

Phi-4-迷你指令

它也是一个轻量级模型,支持 3.8B 参数和 128k 代币,但是这个是强调指令遵循性能这是一种设计。使用合成数据和公共领域数据的 SFT/DPO 提高了安全性和稳定性,并且在 MMLU-Pro、GPQA、ARC 和 BoolQ 等各种基准上与 Llama 3.2-3B 和 Mistral-3B 等类似模型竞争或优于类似模型。

许可和商业使用

所有 Phi-4 系列成员均在 MIT 许可下发布。商业用途没有限制。它有多种变体,从轻量级到专门用于推理,其特点是能够部署在从教育领域到边缘环境、研究和开发以及商业应用的广泛应用中。

下表总结了每种型号的主要功能、性能点、许可证形式和商业可用性。

摘要:开源法学硕士

在快速发展的LLM开源领域,选项在性能和实用性方面不断扩大,但关注许可证的内容也很重要。对于工程师和研究人员来说,从性能和许可角度考虑适合其项目的模型非常重要。让我们明智地使用开源法学硕士,并考虑到每个模型的特点。